Bienvenue dans notre résumé mensuel, où vous pouvez retrouver toutes les histoires AIhub que vous avez peut-être manquées, parcourir les dernières nouvelles, récapituler les événements récents et bien plus encore. Ce mois-ci, nous entendons parler de l’effet des ressources informatiques sur la recherche en IA, apprenons à créer des explications pour les systèmes de prise de décision basés sur l’IA et découvrons l’effet modérateur du vote instantané.

Rencontrer des chercheurs travaillant sur l’IA explicable

Dans une série d’entretiens, nous discutons avec certains des Consortium doctoral AAAI/SIGAI participants d’en savoir plus sur leurs recherches. Lors de nos deux dernières interviews, nous avons rencontré Balint Gyevnár et Mike Lee et interrogé sur leur travail sur différents aspects de l’IA explicable.

Science ouverte ou scientifique fermée

Le Coin café AIhub capture les réflexions des administrateurs d’AIhub au cours d’une courte conversation. Ce mois-ci, nos experts considèrent le débat autour de la science ouverte ou fermée.

Les capacités émergentes des grands modèles linguistiques sont-elles un mirage ?

Rylan Schaeffer, Brando Miranda et Sanmi Koyeo gagné un Prix de l’article exceptionnel NeurIPS 2023 pour leur travail Les capacités émergentes des grands modèles linguistiques sont-elles un mirage ? Dans leur article, ils présentent une explication alternative des capacités émergentes dans les grands modèles de langage. Nous avons parlé à Brando sur ce travail, leur théorie et ce qui l’a inspiré.

Le calcul est-il la contrainte majeure de la recherche en IA ?

Dans leur travail Démocratisation des ressources : le calcul est-il la contrainte contraignante pour la recherche en IA ?présenté à l’AAAI 2024, Rebecca Gelles, Veronica Kinoshita, Micah Musser et James Dunham étudier l’accès des chercheurs au calcul et l’impact que cela a sur leur travail. Dans cet entretienRebecca et Ronnie nous parlent de ce qui a inspiré leur étude, de leur méthodologie et de certaines de leurs principales conclusions.

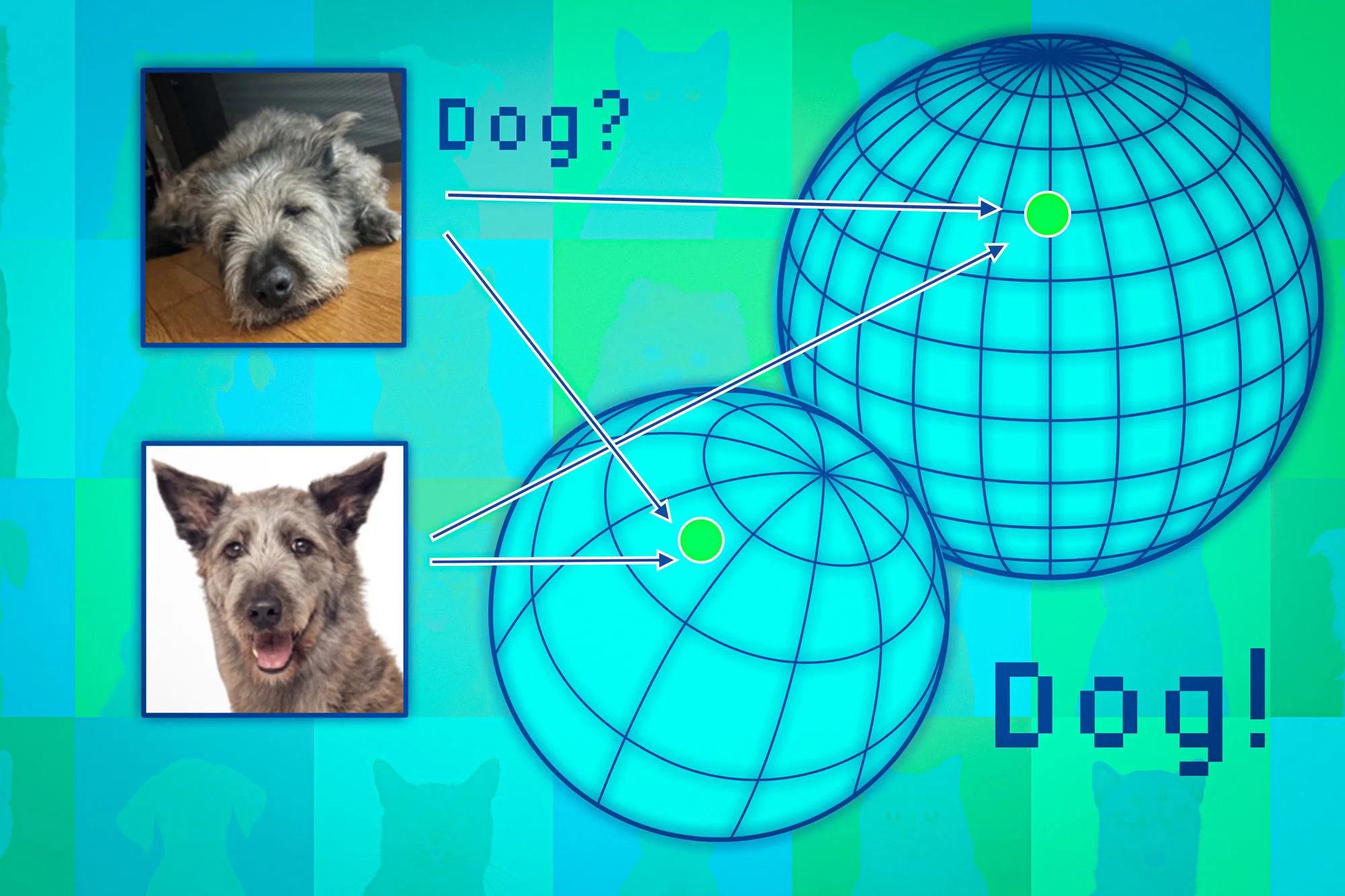

L’effet modérateur du second tour instantané

Dans cet article de blog, Kiran Tomlinson écrit sur les travaux présentés à l’AAAI 2024 sur le vote instantané, un système dans lequel les électeurs classent les candidats, plutôt que de proposer uniquement leur premier choix. Le candidat ayant obtenu le moins de voix pour la première place est éliminé, les voix étant réattribuées au candidat suivant à chaque tour de scrutin. Ce processus est répété jusqu’à ce qu’un candidat reste ou jusqu’à ce qu’un candidat atteigne la majorité. Kiran et ses collègues fournissent un support mathématique à l’argument selon lequel le vote instantané favorise les candidats modérés, contrairement à la pluralité (où chacun est invité à choisir son favori et le candidat ayant obtenu le plus de voix l’emporte).

Explorer la relation entre l’anthropomorphisme dans les assistants vocaux et la perception de la sécurité des utilisateurs

Dans leur journal L’effet de l’anthropomorphisme des assistants vocaux virtuels sur la sécurité perçue en tant qu’antécédent au shopping vocal, Guillermo Calahorra-Candao et María José Martín-de Hoyos explorez les perceptions des utilisateurs à l’égard des assistants virtuels dans le domaine des achats vocaux. Ils écrivent sur leurs principales conclusions dans cet article de blog.

La proposition européenne Moonshot dans l’IA prend de l’ampleur

L’ambitieux « Proposition Moonshot » pour la souveraineté européenne dans l’IA, présenté par CLAIRE et euRobotics, en novembre 2023, a été approuvé par l’Association européenne pour l’IA (EurAI) et le Centre d’études politiques européennes (CEPS). La proposition vise à faire de l’Europe une puissance en matière d’IA digne de confiance d’ici 2030. Pour en savoir plus ici.

Publication du rapport sur l’indice IA 2024

Le rapport AI Index vise à suivre, rassembler, distiller et visualiser les données liées à l’intelligence artificielle. Le rapport est publié chaque année et l’édition 2024 de neuf chapitres et 500 pages a été publiée. sorti le 15 avril.

Ateliers sur les approches d’IA explicable pour l’apprentissage par renforcement profond et les modèles de langage responsables

Dans ce quatrième article récapitulatif des ateliers de l’AAAI 2024, les organisateurs des deux événements sur 1) les approches d’IA explicables pour l’apprentissage par renforcement profond et 2) les modèles de langage responsables présentent leur atelier et présentent leurs principaux points à retenir.

gLLMglnlmvlvMMM

Ben Bolker et Jonathan Dushoff a célébré le poisson d’avril avec leur libérationprésentant un grand modèle de langage génératif pour la modélisation mixte/multiniveau généralisée, linéaire ou non linéaire, multivariée à variables latentes.

Morpion

Un robot s’attaque au morpion, avec des résultats amusants.

Notre page ressources

Séminaires en 2024

Série de focus sur l’IA dans le monde

Série de focus sur les ODD de l’ONU

Nouvelles voix dans la série AI

Mots clés: résumé mensuel

Lucy Smith, rédactrice en chef d’AIhub.